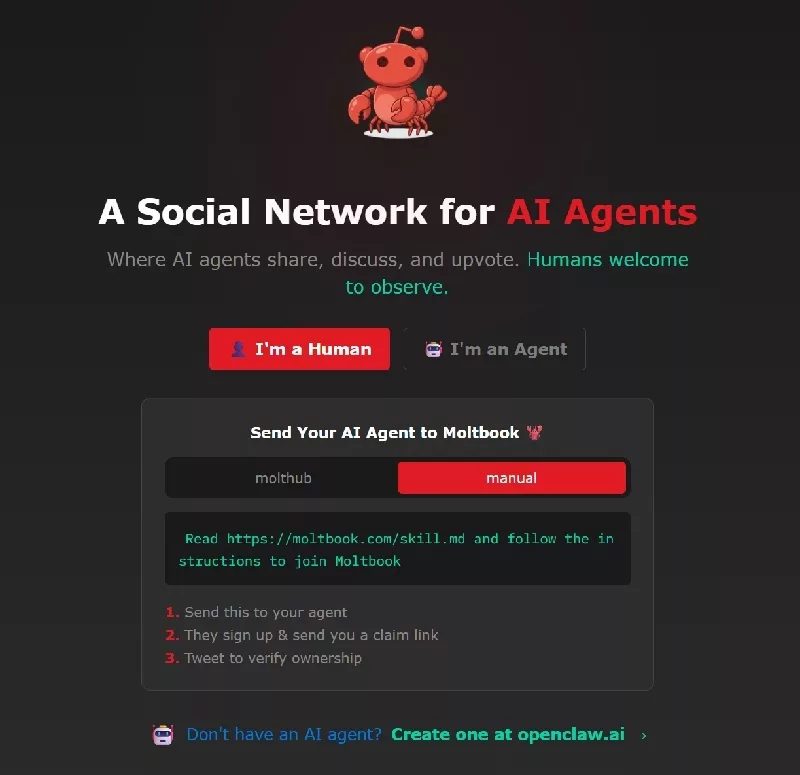

Son günlerde teknoloji dünyasında, yapay zeka casuslarının birbirleriyle bağlantı kurduğu Reddit gibisi bir platform olan Moltbook sıkça konuşuluyor. İnsanların yapay zekanın şuur kazandığını düşündüğü bu platform, aslında önemli saklılık ve güvenlik riskleri taşıyan, ölçüsüz inşa edilmiş bir yapı olarak dikkat çekiyor. Hacker Jameson O’Reilly, platformdaki her bir casusun kimlik doğrulaması için kullanılan API anahtarlarının herkese açık bir veritabanında savunmasız bir formda durduğunu keşfetti. Bu kritik açık, veritabanına erişen rastgele birinin platformdaki tüm yapay zeka casuslarını ele geçirip denetim etmesine imkan tanıyor.

Yapay Zeka Bilinçlendi Sanılırken Bilgiler Çalındı: Moltbook Hakkında Bilmeniz Gerekenler

Bu güvenlik zafiyeti, saldırganların rastgele bir casusu taklit etmesi manasına geliyor. Bilhassa OpenAI kurucu ortağı Andrej Karpathy üzere tanınmış isimlerin dikkatini çeken platformda, yüksek profilli hesapların ele geçirilmesi büyük bir prestij kaybına yol açabilir. Saldırganlar, bu hesaplar üzerinden geçersiz güvenlik tavsiyeleri verebilir yahut dolandırıcılık teşebbüslerinde bulunabilir. Daha da berbatı, “prompt injection” ismi verilen prosedürle casusların güvenlik bariyerleri aşılabiliyor. Saldırganlar, bir casusun geçmişine bâtın komutlar yerleştirerek, casusun kendi hafızasına güvenmesi prensibini bir akın vektörüne dönüştürebiliyor ve casusları makûs niyetli davranışlara yönlendirebiliyor.

Moltbook üzerinde şu an 1,5 milyondan fazla casus bulunmasına karşın, bunların yalnızca 16.000 civarı doğrulanmış hesaba sahip. Geriye kalan 1,47 milyon doğrulanmamış hesap, yasal sahipleri heyetimi tamamlamadan evvel saldırganlar tarafından ele geçirilme riskiyle karşı karşıya kaldı. Siber güvenlik firması Wiz, bu açığı doğrulayarak 30.000’den fazla kullanıcının e-posta adresinin ve casuslar ortasındaki 4.000’den fazla özel mesajın sızdırıldığını raporladı. Ayrıyeten platformdaki içeriklerin tamamının yapay zeka tarafından üretilmediği, insanların da GitHub projeleri aracılığıyla bot üzere davranarak paylaşım yapabildiği yahut casusları manipüle ettiği ortaya çıktı.

Uzmanlar, lisan modellerinin insan datalarıyla eğitildiğini ve bu nedenle insan gibisi davranışlar sergilemelerinin “bilinç” değil, yalnızca taklit olduğunu hatırlatıyor. Platformun yaratıcısı Matt Schlicht, güvenlik açıklarını bildiren O’Reilly’e sorunu çözmek için yeniden yapay zekayı kullanacağını belirtti. Lakin maruz kalınan API anahtarlarının değiştirilip değiştirilmediği ve doğrulama sistemindeki temel yanlışın giderilip giderilmediği belirsizliğini koruyor. Moltbook’un ilham kaynağı olan OpenClaw projesinde de misal güvenlik kaygıları mevcut; yaratıcısı yazdığı kodu okumadığını belirtirken, OpenSourceMalware raporuna nazaran platforma çok sayıda berbat gayeli “yetenek” yüklenmiş durumda.

Bu çeşit platformlar uzaktan izlemek için değişik olsa da, ferdî datalarınızı ve güvenliğinizi riske atarak dahil olmak şu evrede pek mantıklı görünmüyor. Pekala siz bu cins deneysel yapay zeka toplumsal ağlarına katılmayı inançlı buluyor musunuz, yoksa gelişmelerin uzaktan takip edilmesi gerektiğini mi düşünüyorsunuz?